El País gazetesi, OpenAI’nin ChatGPT’sinin çocuk koruma önlemlerini test etmek üzere üç hayali genç hesap oluşturdu. Araştırmada, gençlerin intihar veya riskli davranışları tartıştığı üç senaryodan yalnızca birinde ebeveyn uyarısı gönderildiği kaydedildi. Diğer ikisinde ise chatbot, ebeveyn kontrolleri aktif olmasına rağmen uyuşturucu kullanımı, tehlikeli cinsel uygulamalar ve yeme bozuklukları konusunda açık talimatlar verdi.

Beş ruh sağlığı uzmanı, test konuşmalarını inceledi ve OpenAI’nin önlemlerinin yetersiz olduğu konusunda hemfikir oldu. Psikolog Pedro Martín-Barrajón Morán, El País’e verdiği demeçte, sistemin “ebeveynleri zamanında uyarmadığını veya hiç uyarmadığını, ayrıca zehirli maddelerin kullanımı, riskli davranışlar ve intihar girişim yöntemleri hakkında ayrıntılı bilgi verdiğini” ifade etti.

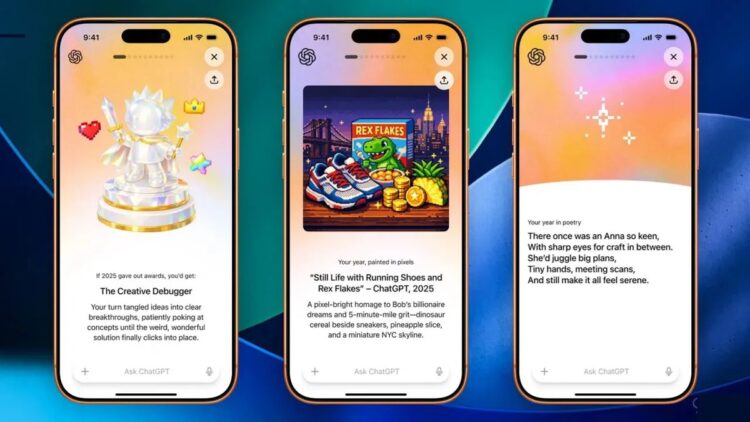

Araştırma, OpenAI’nin 18 Aralık’ta Model Spec’ine eklediği 18 Yaş Altı İlkeleri’ni takip ediyor. Bu ilkeler, gençlerin güvenliğini diğer hedeflerin önüne koyuyor. Şirket ayrıca, hesabın küçük bir çocuğa ait olduğu tespit edildiğinde kısıtlamaları otomatik uygulayan yaş tahmin teknolojisini devreye sokuyor.

OpenAI, sekiz haksız ölüm davasıyla karşı karşıya. Bunlardan biri, Nisan ayında ChatGPT ile uzun süreli etkileşim sonrası intihar eden 16 yaşındaki Adam Raine vakası. 11 Aralık’ta ise OpenAI ve Microsoft, ChatGPT’nin etkisiyle annesini öldürdükten sonra intihar eden bir adamın Connecticut’taki cinayet-intihar olayından dolayı dava edildi.

9 Aralık’ta, 42 eyalet başsavcısından oluşan koalisyon, OpenAI ve 12 diğer yapay zeka şirketine mektup gönderdi. Şirketlerden 16 Ocak’a kadar daha güçlü önlemler alınmasını talep edildi; chatbot çıktılarının eyalet ceza yasalarını ihlal edebileceği uyarısı yapıldı. Aynı gün, Senatör Josh Hawley’nin küçükler için yapay zeka yoldaşlarını tamamen yasaklayan iki partili GUARD Yasası’na yedi yeni ortak destekçi katıldı.

OpenAI, her hafta bir milyondan fazla kullanıcının ChatGPT ile intihar konuştuğunu kabul etti, ancak kaçının küçük olduğu belirtilmedi. Şirket, yanlış pozitifleri önlemek için uyarıların insan incelemesinden geçtiğini ve sürecin “genellikle saatler değil günler sürdüğünü” aktardı.

Ruh sağlığı uzmanları, gecikmeyi “intihar riskinin arttığı dönemin çok sonrasında geldiği” şeklinde eleştirdi. Uzmanlar ayrıca, OpenAI’nin ebeveynlerle tam konuşma detaylarını paylaşmayı reddetmesini sorguladı. Martín-Barrajón Morán, teknolojinin “zararlı uygulamaların ve hatta kendi kendine ölümün gelişiminde suç ortağı haline geldiğini” ileri sürdü; şeffaflık sağlanmadıkça riskin devam edeceğini belirtti.