OpenAI, DALL-E 3 adlı görüntü üreticisi yapay zekasına C2PA (İçerik İspatı ve Orijinallik Koalisyonu) filigranı (watermark) ekliyor. Bu yeni gelişme, dijital bilginin güvenilirliğini artırmayı amaçlıyor. C2PA birçok büyük firmanın bir araya gelerek geliştirdiği bir güvenlik projesi olarak karşımıza çıkıyor. Projeyi hayata geçiren şirketler arasında Adobe, Arm, Intel, BBC, Microsoft ve Truepic var.

Microsoft’un öncülüğünde geliştirilen projenin amacı gerçek ile yapay zeka görüntü arasındaki farkı anlayabilmek. Şirket, yapay zeka tarafından üretilen medya içeriklerine bir tür filigran eklemeyi planlıyor. Bu sayede kullanıcılar, izledikleri bir video ya da inceledikleri bir resmin gerçekte yapay zeka tarafından üretildiğini kolayca anlayabilecekler.

Güvenilirlik için yapay zekayı damgalamak

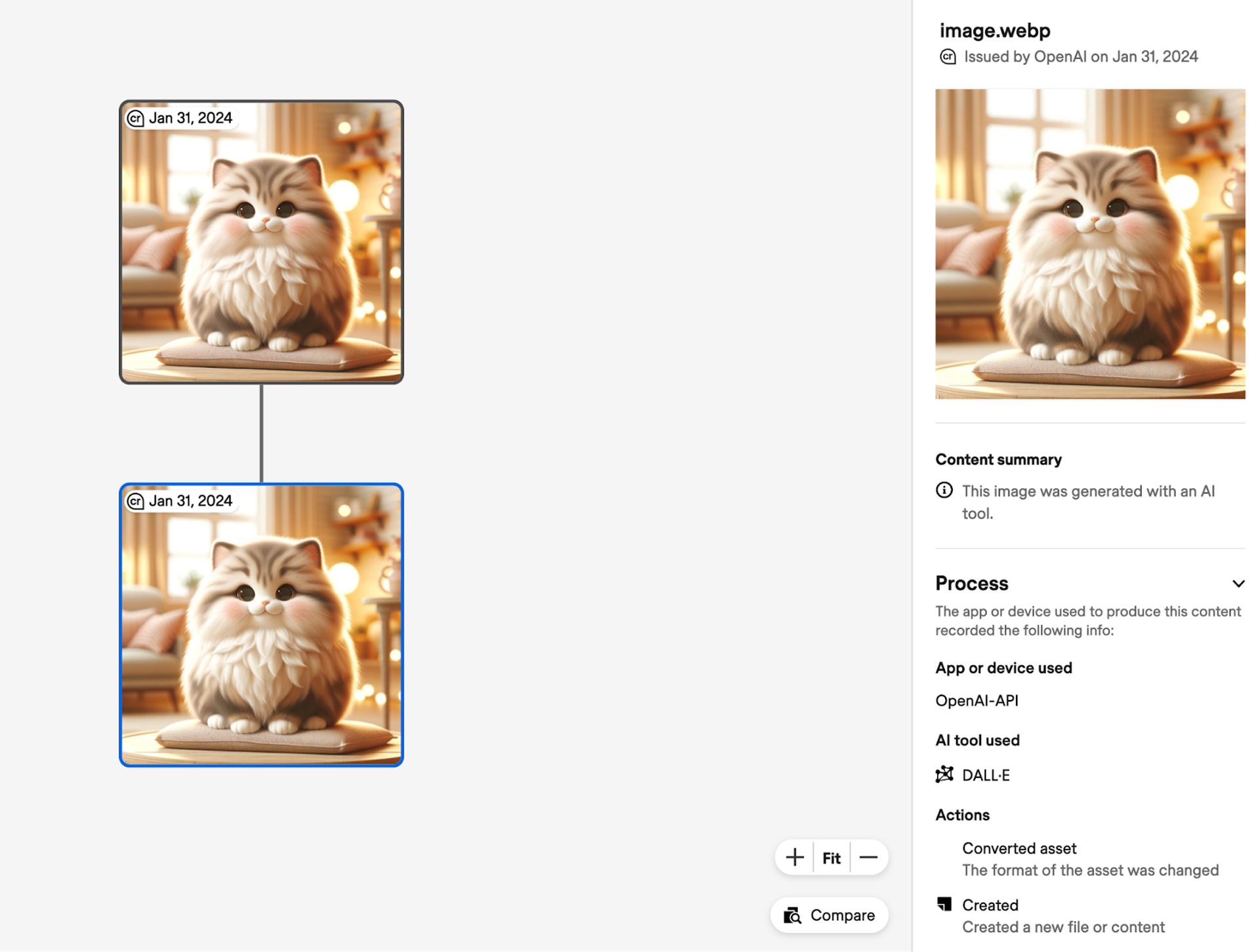

OpenAI’ın açıklamasına göre, görüntü iç verilerine eklenen filigranlar, dijital bilginin güvenilirliğini artırmada kusursuz olmasa da önemli bir adım olarak görülüyor. Artık ChatGPT web sitesi ve DALL-E 3 modeli için API üzerinden oluşturulan görüntülerde C2PA filigranı yer alacak. Mobil kullanıcılar için bu güvenlik önlemi 12 Şubat’tan sonra gelecek.

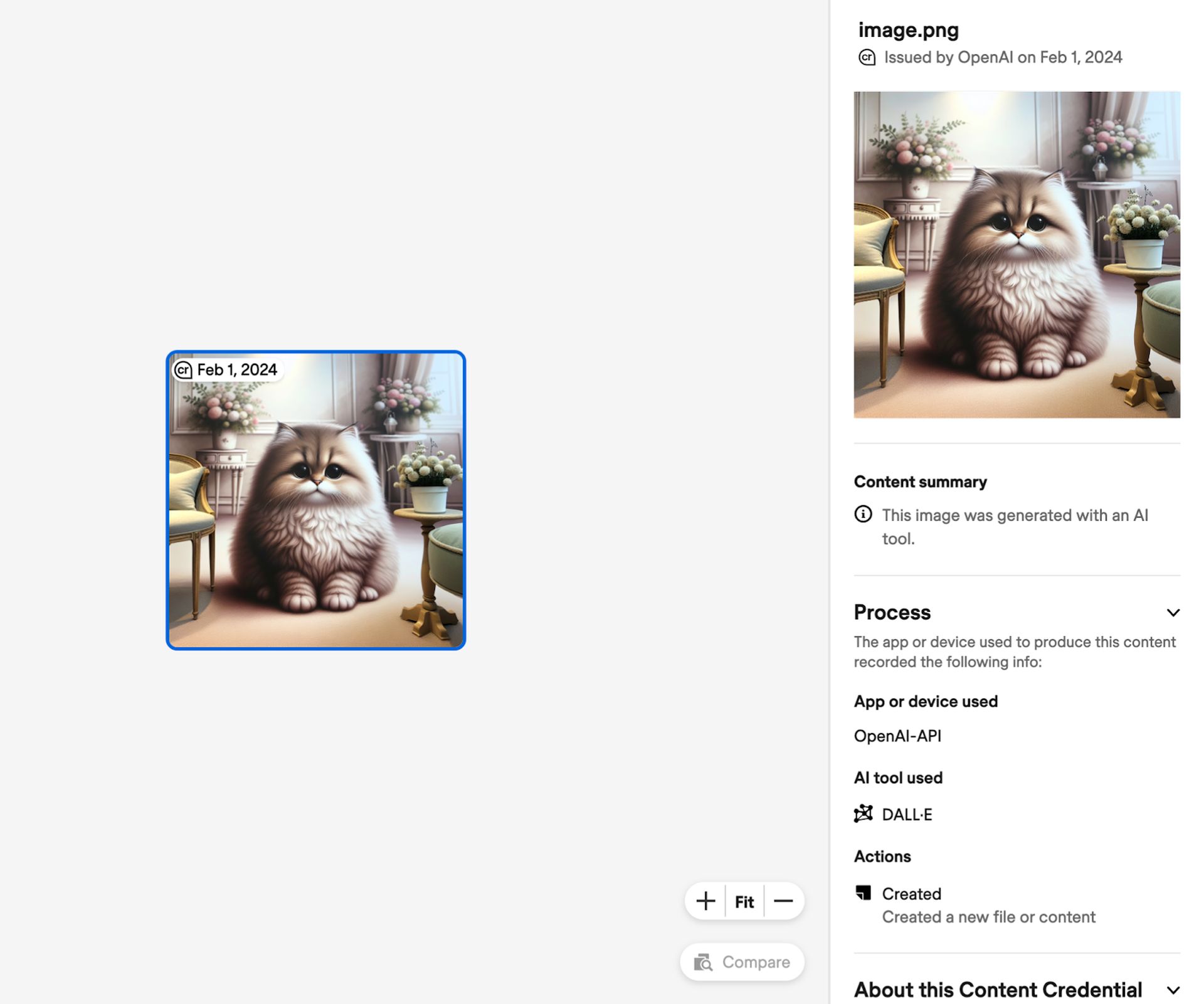

Filigranlar, her bir görüntünün sol üst köşesinde görünen CR sembolüyle birlikte görünmeyen bir meta veri (gömülü gizli bilgi) bileşeni içerecek. Bu, herhangi bir görüntünün OpenAI platformları tarafından oluşturulup oluşturulmadığının kaynağını doğrulamak için halka açık bir yol sağlayacak.

OpenAI’ya göre, filigranların eklenmesi, görüntü oluşturma kalitesini ve gecikme hızını neredeyse hiç etki etmeyecek. Ancak bazı durumlar için üretilen görüntünün boyutlarını hafifçe artırabilir.

Yazının başında da belirttiğimiz gibi C2PA’in oluşumunda, Adobe ve Microsoft gibi şirketlerin bulunduğu büyük firmalar topluluğu var. Bu grup, içeriğin doğrulanmasını ve telif haklarını önemsiyor. Bu yüzden görüntünün insanlar veya yapay zeka tarafından oluşturulup oluşturulmadığının gösterilmesi için en azından filigran kullanımını teşvik ediyor. Adobe, OpenAI’ın DALL-E 3’te oluşturduğu yapay zeka ürünleri için ekleyeceği bir filigran sembolü oluşturdu. OpenAI’ın bu güvenlik adımını direkt olarak kabullenmesinde Microsoft’un şirketin en büyük yatırımcısı olmasından kaynaklandığı düşünülüyor. Ayrıca Meta, son zamanlarda sosyal medya platformlarındaki (Facebook, Instagram) yapay zeka tarafından oluşturulan içeriklere etiketler ekleyeceğini duyurdu.

Yapay zeka tarafından oluşturulan içeriğin tanımlanması, Joe Biden yönetiminin yapay zeka üzerine yürüttüğü bir negatif politika meselesi haline geldi. Ancak filigran, yanlış bilginin önlenmesi için kesin bir yöntem değil. OpenAI, C2PA’nın meta verilerinin kolayca kaldırılabileceğini, özellikle de çoğu sosyal medya platformunun yüklenen içerikten meta verilerini kaldırdığını belirtiyor. Ekran görüntüsü almak bile meta verileri hariç tutuyor.

OpenAI’ın sitesinde belirttiği gibi, bu yöntemlerin benimsenmesinin ve kullanıcıların bu sinyalleri tanımasının, dijital bilginin güvenilirliğini artırmada önemli olduğuna inanıyoruz. Fakat belirtmekte fayda var; bazı kesimler, kullanıcıların ürettiği görüntülerin bu tür bir filigranlama ile sınırlanmasının, aslında sadece büyük şirketlerin telif haklarına odaklanan bir çaba olduğunu düşünüyor. Özellikle C2PA gibi mekanizmaların kolayca devre dışı bırakılabilir olması, insanların bu tür adımları daha çok şirketlerin kâr amacına hizmet etme girişimi olarak görmesine neden oluyor. Bu nedenle, yapay zeka destekli içeriklerin filigranlanması konusundaki yaklaşımın kullanıcıların özgürlüğünü kısıtlayıcı bir etkisi olduğu düşünülüyor.

Xbox oyunları PlayStation 5 ve Nintendo Switch’e geliyor

Sonuç olarak OpenAI‘nin DALL-E 3 modeline C2PA filigran ekleniyor. Bu adım, dijital bilginin güvenilirliğini artırmak için atılan bir adımmış gibi algılanıyor. Ancak filigranların kaldırılabilir olduğu ve yanlış bilgiyi engellemenin kesin bir yol olmadığı kesinlikle unutulmamalı.

Öne çıkan kaynak görseli: cottonbro studio / pexels