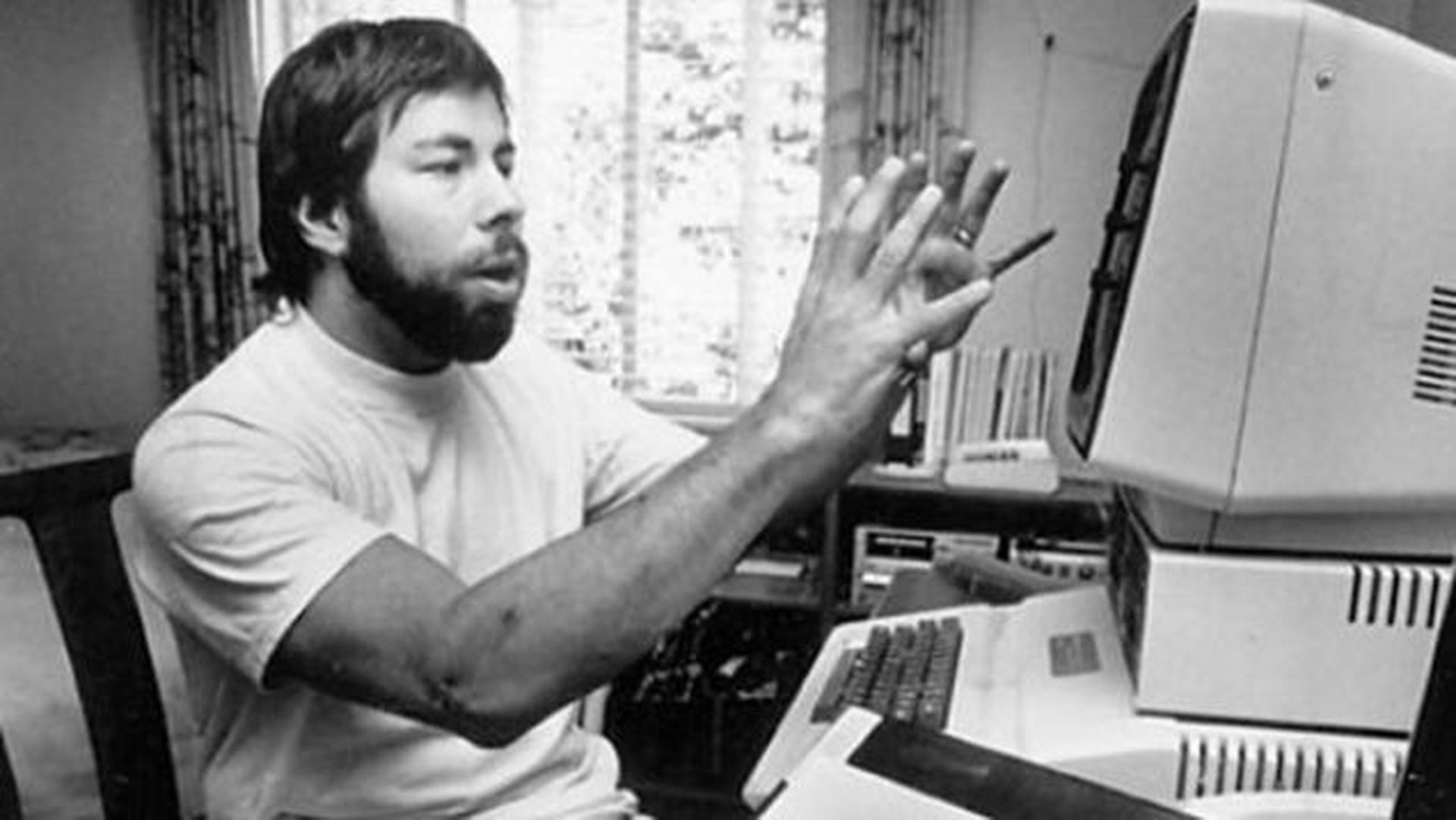

Aralarında Steve Wozniak ve Prens Harry’nin de bulunduğu 800’den fazla tanınmış isim, bilim insanı, eski askeri lider ve CEO, süper zekaya yol açabilecek yapay zeka (AI) çalışmalarının yasaklanmasını talep eden bir bildiri imzaladı. Bildiride, “Süper zekanın gelişiminin, güvenli ve kontrol edilebilir bir şekilde yapılacağına dair geniş bir bilimsel fikir birliği ve güçlü bir kamu onayı olana kadar yasaklanmasını talep ediyoruz,” ifadeleri yer aldı.

İmzacılar arasında AI araştırmacısı ve Nobel ödüllü Geoffrey Hinton, eski Trump danışmanı Steve Bannon, eski Genelkurmay Başkanı Mike Mullen ve rapçi Will.i.am gibi farklı sektörlerden ve siyasi görüşlerden isimler bulunuyor. Bildiri, AI alanındaki gelişmelerin kamuoyunun anlayabileceğinden daha hızlı gerçekleştiğini belirten Future of Life Institute tarafından yayınlandı.

Enstitünün yönetici direktörü Anthony Aguirre, NBC News’e verdiği demeçte, “Bu yol bir düzeyde AI şirketleri, kurucuları ve onları yönlendiren ekonomik sistem tarafından bizim için seçildi, ancak neredeyse hiç kimseye ‘Bu bizim istediğimiz şey mi?’ diye sorulmadı,” dedi.

Yapay genel zeka (AGI), makinelerin insanlar kadar iyi akıl yürütme ve görevleri yerine getirme yeteneğini ifade ederken, süper zeka AI’ın insan uzmanlardan bile daha iyi işler yapmasını sağlayacak bir seviyeyi tanımlıyor. Bu potansiyel, eleştirmenler tarafından insanlık için ciddi bir risk olarak gösteriliyor. Ancak yapay zeka, şu ana kadar yalnızca dar bir görev yelpazesinde faydalı olduğunu kanıtladı ve otonom sürüş gibi karmaşık görevlerde tutarlı bir şekilde başarısız oldu.

Son dönemde çığır açan bir gelişme olmamasına rağmen, OpenAI gibi şirketler yeni AI modellerine ve bu modelleri çalıştırmak için gereken veri merkezlerine milyarlarca dolar yatırım yapıyor. Meta CEO’su Mark Zuckerberg, süper zekanın “görünürde” olduğunu belirtirken, X CEO’su Elon Musk süper zekanın “gerçek zamanlı olarak gerçekleştiğini” söyledi. OpenAI CEO’su Sam Altman ise süper zekanın en geç 2030 yılına kadar ortaya çıkmasını beklediğini ifade etti. Bu liderlerin hiçbiri veya şirketlerinden önemli bir isim, Future of Life Institute’un bildirisini imzalamadı.

Bu, AI gelişiminin yavaşlatılmasına yönelik tek çağrı değil. Geçen ay, aralarında 10 Nobel ödüllü ismin de bulunduğu 200’den fazla araştırmacı ve kamu görevlisi, yapay zekanın risklerine karşı bir “kırmızı çizgi” belirlenmesi için acil bir çağrı yayınlamıştı. Ancak bu metin, süper zekadan ziyade kitlesel işsizlik, iklim değişikliği ve insan hakları ihlalleri gibi halihazırda ortaya çıkmaya başlayan tehlikelere odaklanıyordu. Diğer eleştirmenler ise potansiyel bir yapay zeka balonunun sonunda patlayarak ekonomiyi de beraberinde aşağı çekebileceği konusunda uyarılarda bulunuyor.